Runway Gen-3 Alpha

Gen-3 Alpha basiert auf einer völlig neuen Infrastruktur und führt eine Reihe neuer Funktionen und Verbesserungen ein, um komplizierte Eingabeaufforderungen zu verstehen und lebensechte Clips mit den authentischsten Bewegungen, Details und der authentischsten Physik zu erstellen. Testen Sie Gen-3 Alpha hier kostenlos!

Hauptmerkmale

- Überlegene Videoausgabe : Gen-3 Alpha kann eine Videoausgabe in Kinoqualität mit detaillierten und lebensechten Bildern in jedem Bild erzeugen.

- Animator für den Act One : Animieren Sie Standbilder von Figuren mit realistischen, gleichmäßigen Bewegungen.

- Video-Extender : Verwenden Sie diese Option, um Ihre Videos bei jeder Verwendung um bis zu 10 Sekunden neuen Inhalt zu verlängern.

- Hi-Fi-Ausgang : Gen-3 Alpha Videos sind konsistenter, flüssiger und detailreicher, was durch die Bank zu natürlicheren Bildern führt.

- Erweiterte zeitliche Steuerung : Erstellen Sie unglaublich einzigartige und dynamische Übergänge zwischen Szenen, indem Sie nur Textaufforderungen verwenden.

- Lebensechte Menschen : Menschen sehen in Gen-2 besser aus als je zuvor, mit den authentischsten Bewegungen und Reaktionen.

- Lippensynchrones Audio : Damit können Sie den Ton sprechender Personen mit den präzisen Lippenbewegungen der Videoobjekte synchronisieren.

- Video zu Video : Verwenden Sie ein Video als Grundlage und transformieren Sie es auf verschiedene Weise.

Überlegene Videoausgabe

Das Gen-3 Alpha Modell von Runway wurde umfassend mit Video- und Bildinhalten trainiert, um intelligenter als die vorherige Version zu werden. Es bietet drei Formen der KI-Generierung: Text zu Video, Bild zu Video und Text zu Bild. Und es bringt spannende Funktionen mit, wie Motion Brush, erweiterte Kamerasteuerung und den Regiemodus.

Es ermöglicht Benutzern die Erstellung hochdetaillierter Videos mit komplexen Szenenwechseln, einer großen Bandbreite an filmischen Auswahlmöglichkeiten und detaillierten künstlerischen Anweisungen.

| Prompt | Eingabebild | Videoausgabe |

| Mit hoher Geschwindigkeit und dynamischem Winkel fixiert die Kamera eine Plastiktüte, die durch die Luft über einer sandigen Szene schwebt. Die Tüte ist halbtransparent und schwebt im Wind auf und ab, bleibt aber während der gesamten Szene klar sichtbar und im Fokus. | Keiner |  |

| Die behandschuhten Hände ziehen, um das Gesicht aus Kaugummimaterial zu strecken |  |  |

| Die Seeanemonen wiegen und treiben natürlich im Wasser. Die Kamera bleibt ruhig. |  |  |

Act One

Act One ist eine der aufregendsten Ergänzungen zur Gen-3 Alpha Version von Runway. Es handelt sich dabei um ein Tool zur Charakteranimation, das darauf abzielt , möglichst realistische und authentische Gesichtsbewegungen , Sprachmuster und Ausdrücke bei menschlichen Motiven zu erzeugen.

Damit können Benutzer ihre eigenen Charakterdarstellungen erstellen, die genauso aussehen wie die echten. Und es funktioniert in verschiedenen Stilen, von fotorealistischen Videos sprechender Personen bis hin zu niedlichen animierten Szenen im Stil großer Animationsstudios wie Disney und Pixar.

Es funktioniert so gut, weil das Tool anhand von Unmengen an Gesichtsanimationsdaten und Mocap trainiert wurde, was viele neue Möglichkeiten für den kreativen Ausdruck eröffnet.

| Fahrleistung | Ausgabevideo |

| |

| |

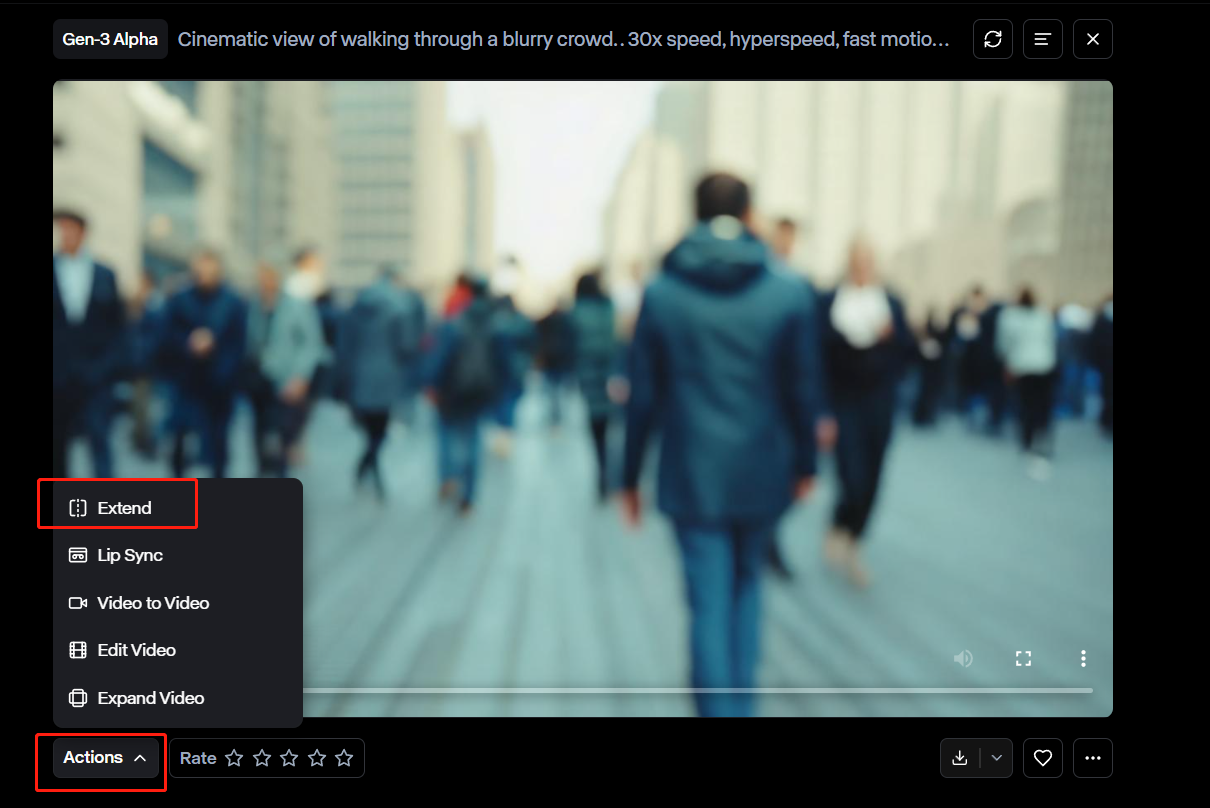

Video verlängern

Mit Gen-3 Alpha können Sie Ihre KI-generierten Videos länger als zuvor machen, indem Sie in 5-10-Sekunden-Schritten neue Inhaltsabschnitte hinzufügen. Und Sie können ein einzelnes Video bis zu dreimal verlängern, um es deutlich länger als ursprünglich zu machen (bis zu maximal 40 zusätzliche Sekunden).

Auch das Verlängern von Videos geht schnell und einfach – wählen Sie dazu einfach im Menü „Aktionen“ neben Ihrem Video das Werkzeug „Verlängern“ aus.

Standardmäßig fügt das Tool nach dem letzten Frame Ihres Originalvideos neuen Inhalt hinzu. Und Sie können Ihren eigenen Text eingeben, um dem KI-Modell mitzuteilen, was in die Erweiterung aufgenommen werden soll, und dabei die Szene, die Kamerabewegung und andere Faktoren beschreiben.

Bei Gen-3 Alpha können Sie zudem je nach Wunsch zwischen fünf oder zehn Sekunden langen Additionen wählen.

| Originalvideo | Erweitertes Video |

Hi-Fi-Ausgang

Runways Gen-3 Alpha bringt Konsistenz und High-Fidelity-Ausgabe im Vergleich zu früheren Versionen wie Gen-2 auf ein neues Niveau.

Es ist in der Lage, Videos zu erstellen, die die authentischsten, lebensechtesten Bewegungen darstellen, darunter Gehen, Laufen, Joggen und Springen. Jede Bewegung verläuft sauber und realistisch, ohne seltsame Störungen oder andere KI-Unklarheiten, sodass das Publikum gefesselt und in das Geschehen eingebunden bleibt.

Darüber hinaus ist das neue Modell in der Lage, Bewegungen und Bilder von Bild zu Bild konsistent zu halten. Dies ist seinem besseren Verständnis von Eingabeaufforderungen und besseren Algorithmen als bei der vorherigen Gen-2 -Version zu verdanken.

All dies wird auch schneller bereitgestellt als je zuvor – Gen-3 Alpha ist doppelt so schnell wie Gen-2.

Erweiterte zeitliche Steuerung

Das Gen-3 Alpha Modell von Runway wurde darauf trainiert, komplexe, vielschichtige Eingabeaufforderungen zu verstehen, die mehrere Szenen und zeitliche Ideen in einem Paket enthalten. Aus diesem Grund ist es sehr gut darin, Eingabeaufforderungen zu verstehen, die Szenen oder Bilder beschreiben, die verschiedene Änderungen oder Übergänge durchlaufen.

Für den Endbenutzer bedeutet dies, dass Gen-3 Alpha effizient sanfte, flüssige Übergänge zwischen Szenen oder Segmenten jedes Videos erzeugt. Außerdem haben Sie mehr Kontrolle über die Keyframing-Funktion, sodass Sie gezielt bestimmte Momente im Video festlegen können, in denen bestimmte Dinge geschehen oder Elemente erscheinen.

Mit so viel Kontrolle können Benutzer genau die Videos erstellen, die sie möchten, ohne Kompromisse eingehen zu müssen.

Lebensechte Menschen

Runways Gen-3 Alpha wurde darauf trainiert, seine menschlichen Protagonisten so realistisch wie möglich aussehen zu lassen. Mit anderen Worten: Menschen in diesen KI-Videos sind kaum von echten Menschen zu unterscheiden.

Ob sie nun sprechen, Gesichtsausdrücke machen oder verschiedene Aktivitäten wie Laufen und Springen ausführen, die Menschen in diesen Videos sind äußerst authentisch. Dies gibt den Benutzern viele Möglichkeiten, Geschichten zu erzählen und menschenorientierte Inhalte zu erstellen.

Lippensynchrones Audio

Mit der Funktion „Lippensynchronisation“ können Sie eine Audiospur oder Sprache mit realistischen Lippenbewegungen Ihrer Figuren und Motive synchronisieren.

Sie können Ihren KI-Charakteren ein eigenes Skript vorgeben, Ihre eigene Stimme direkt in Runway aufnehmen oder eine Audiodatei hochladen. Lip Sync synchronisiert sie dann mit den Mundbewegungen des Charakters, sodass es wirklich so aussieht, als würde er den Ton selbst wiedergeben.

Bei Verwendung der Lippensynchronisation können Sie außerdem verschiedene Sprachoptionen konfigurieren und auswählen.

Video-zu-Video-Generierung

Laden Sie einfach ein Video hoch (oder generieren Sie es), das Sie als Basis oder Referenzpunkt für das KI-Modell verwenden können. Anschließend können Sie das Video auf verschiedene Weise transformieren oder ändern, z. B. ein realistisches Video in ein animiertes umwandeln oder umgekehrt.

| Eingangsvideo | Texteingabeaufforderung | Ausgabevideo |

| 3D-Halbton im CMYK-Stil. Halbtondruckpunkt. Comicbuch. Kräftige Farben in Schichten aus cyanblauen, gelben, magentavioletten und schwarzen kreisförmigen Punkten. |  |

Beste Eingabeaufforderungen zur Verwendung von Runway Gen-3 Alpha

Um das Beste aus Gen-3 Alpha herauszuholen, müssen Sie die besten Eingabeaufforderungen verwenden. Runway selbst empfiehlt Benutzern, sich an die Formel „[Kamerabewegung]: [Szene einführen]. [weitere Details]“ zu halten.

Sie könnten zum Beispiel eine Aufforderung wie „langsamer horizontaler Schwenk, eine junge Frau geht durch die Wüste, dann beginnt es zu regnen“ eingeben.

Je detaillierter Sie Ihre Eingabeaufforderungen gestalten können, desto spezifischer und maßgeschneiderter werden Ihre Ergebnisse. Wenn Sie also eine bestimmte Vision davon haben, wie Ihr Video aussehen soll, sollten Sie am besten detailliert vorgehen.

Wir können dies auf das vorherige Beispiel anwenden, um etwa Folgendes zu erhalten:

„Die Kamera schwenkt langsam von links nach rechts über eine Wüste aus goldenem Sand. Eine Frau Mitte 20 geht langsam durch die Szene. Sie trägt ein geblümtes Kleid. Sie blickt auf, als aus grauen Wolken darüber Regen zu fallen beginnt.“

Hier sind ein paar Bonustipps, um Ihre Eingabeaufforderungen so gut wie möglich zu gestalten:

- Geben Sie so viele Details wie möglich an, ohne zu übertreiben. Gen-3 Alpha funktioniert am besten mit „Sweet Spot“-Eingabeaufforderungen, die weder zu einfach noch zu komplex sind.

- Informieren Sie sich über die Begriffe zu Kamerabewegungen und Aufnahmearten, damit Sie dem Tool präzise Anweisungen zum Bildausschnitt und den Kamerawinkeln geben können.

- Verwenden Sie beim Erstellen ähnlicher oder nachfolgender Szenen den gleichen Stil in Ihren Eingabeaufforderungen, damit ein gewisses Maß an Konsistenz gewahrt bleibt.

- Probieren Sie die benutzerdefinierten voreingestellten Eingabeaufforderungen von Runway aus und speichern Sie Ihre Favoriten, um sie später wiederzuverwenden.

Runway Gen-2 gegen Gen-3 Alpha gegen Gen-3 Alpha Turbo

| Merkmale | Gen-2 | Gen-3 Alpha | Gen-3 Alpha Turbo |

| Videodauer | 4 Sekunden | 5/10 | |

| Videoauflösung | 1408 × 768 Pixel (Hochskalierung aus) 2816 × 1536 Pixel (Hochskalieren aktiviert) | 1280 x 768 Pixel | 1280 x 768 Pixel 768 x 1280 Pixel |

| Text zu Video | |||

| Bild zu Video | |||

| Video zu Video | |||

| Bewegungspinsel | |||

| Kamerasteuerung | |||

| Benutzerdefinierte Stile | |||

| Lippensynchronisation | |||

| Erster Akt | |||

| Video erweitern | |||

Reddit Bewertungen von Gen-3 Alpha

Was also denken allgemeine Benutzer über Runways Gen-3 Alpha? Derzeit gehen die Meinungen zu diesem Tool eher auseinander.

Einige Benutzer haben erklärt, dass sie vorerst bei der Verwendung von Gen-2 bleiben werden, da sich Gen-3 erst in der Entwicklungsphase „Alpha“ befindet und noch einige Verbesserungen benötigt, bevor es sein Potenzial ausschöpfen kann.

Kommentar

von u/West_Persimmon_6210 aus der Diskussion

im Runwayml

Andere beschwerten sich über die hohen Kosten für die Nutzung von Gen-3 Alpha, lobten jedoch dennoch die Technologie und die wichtigsten Funktionen, die es eingeführt hat.

Kommentar

von u/Puzzled-Emphasis1116 aus der Diskussion

im Runwayml

Videorezensionen auf YouTube

Weitere Artikel zu Runway Gen-3 Alpha

Lesen Sie weitere Artikel zu Runway Gen-3 Alpha, um Ihr Verständnis dieses Modells zu vertiefen!

FAQs

Was ist die Gen 3 Alpha von Runway ?

Gen-3 Alpha ist die neuste Version des Videogenerierungsmodells von Runway AI . Es bietet im Vergleich zur vorherigen Gen-2 -Version eine Reihe von Verbesserungen und neuen Funktionen, wie beispielsweise die Lippensynchronisationsfunktion.

Was ist der Unterschied zwischen Gen-3 Alpha und Gen-3 Alpha Turbo?

Gen-3 Alpha und Gen-3 Alpha Turbo unterscheiden sich in Bezug auf Effizienz und Kosten. Gen-3 Alpha Turbo ist nämlich viel schneller als normales Gen-3 Alpha, wenn es um die Erstellung von Inhalten geht. Turbo kostet auch weniger, da weniger Credits zum Generieren von Videos benötigt werden, aber Standard-Alpha liefert möglicherweise zuverlässigere Ergebnisse.

Wie unterscheidet sich Gen-3 Alpha von Gen-2 Text/Bild zu Video?

Gen-3 Alpha bringt im Vergleich zu Gen-2 verschiedene Verbesserungen und neue Funktionen mit sich. Es liefert Videos in besserer Qualität, die in Bezug auf Bewegung und Physik konsistenter und realistischer sind.

Wie kann ich Gen-3 Alpha ausprobieren?

Sie können Gen-3 Alpha kostenlos testen, indem Sie sich bei Runway anmelden oder ein anderes Tool verwenden, für das das Runway Gen-3 Alpha -Modell verfügbar ist, beispielsweise Pollo AI . Sie müssen kein Geld ausgeben, um dieses Tool auszuprobieren.

Wie verwende ich Gen3 Alpha?

Gen-3 Alpha funktioniert ähnlich wie viele andere KI-Videogeneratoren auf dem Markt. Sie können entweder ein Bild hochladen, das als Grundlage für die Erstellung von KI-Videos dient, oder eine Eingabeaufforderung eingeben und die verschiedenen Einstellungen konfigurieren, um Ihre Ausgabe zu steuern.

Ist Runway Gen-3 kostenlos?

Nicht vollständig, aber Sie können es kostenlos nutzen, indem Sie sich bei RunwayML für den Basic/Free-Plan anmelden. Damit erhalten Sie jedoch nur eingeschränkten Zugriff auf die Plattform. Wenn Sie vollen Zugriff wünschen, müssen Sie sich für einen kostenpflichtigen Plan anmelden.

Wozu dient Gen 3 Alpha?

Gen-3 Alpha ist ein KI-Videogenerierungsmodell, mit dem Sie realistische, qualitativ hochwertige KI-Videos erstellen können. Es gibt viele mögliche Anwendungen dafür, z. B. die Erstellung von Unterhaltungsinhalten, Anzeigen, Demonstrationen, Tutorials und mehr.

Wie viele Credits benötigt Runway Gen 3?

Derzeit kostet das Erstellen von KI-Videos mit Gen-3 Alpha 10 Credits pro Sekunde. Die Erstellung eines 10-Sekunden-Clips kostet also beispielsweise 100 Credits. Etwas günstiger kommen Sie an Videos, wenn Sie die Turbo-Version von Gen-3 Alpha verwenden, die nur 5 Credits pro Sekunde kostet.

Was ist die maximale Länge der Gen-3 Alpha Generationen?

Derzeit kann Gen-3 Alpha Clips mit einer Länge von bis zu 10 Sekunden erstellen. Sie können die Funktion „Erweitern“ jedoch maximal dreimal verwenden, um Ihren Clips insgesamt 30 Sekunden hinzuzufügen, sodass sie maximal 40 Sekunden lang sind.

Wie hoch ist die Auflösung des Gen 3 Alpha-Videos?

Die Auflösung von mit Gen-3 Alpha (und Gen-3 Alpha Turbo) generierten Videos ist derzeit auf 720p eingestellt. Das Runway -Team hat jedoch erklärt, dass in Zukunft weitere Optionen veröffentlicht werden.

Wie viel kostet Runway Gen-3?

Runway verwendet ein Kreditsystem und kostet 10 Credits für jede Sekunde Video, das Sie mit Gen-3 Alpha erstellen. Sie können verschiedene Abonnements abschließen, die Ihnen unterschiedliche Mengen an Credits einbringen, darunter ein kostenloses Abonnement mit 125 Credits und ein Pro-Abonnement mit 2250 Credits monatlich.