Runway Gen-3 Alpha

Gen-3 Alpha建立在全新基础架构之上,引入了一系列新功能和改进,能够理解复杂的提示,并创建具有最真实动作、细节和物理特性的逼真剪辑。在此免费试用Gen-3 Alpha !

主要特点

- 卓越的视频输出: Gen-3 Alpha可以创建影院级视频输出,每一帧都有细腻逼真的视觉效果。

- Act One动画师:通过逼真、一致的动作为静止的人物图像制作动画。

- 视频延长器:使用此功能可以使您的视频更长,每次使用最多可增加 10 秒的新鲜内容。

- 高保真输出:Gen-3 Alpha视频更加一致、流畅和丰富,从而带来更加自然的视觉效果。

- 高级时间控制:仅使用文本提示,在场景之间实现极其独特且动态的转换。

- 栩栩如生的人物:在Gen-2中,人类看起来比以往更好,具有最真实的动作和反应。

- 口型同步音频:这可让您将人们说话的音频与视频主体的精确嘴唇动作同步。

- 视频到视频:使用视频作为基线并以各种方式对其进行转换。

卓越的视频输出

Runway 的Gen-3 Alpha模型已使用视频和基于图像的内容进行了广泛训练,比之前的版本更加智能。它提供三种形式的 AI 生成:文本转视频、图像转视频和文本转图像。它还带来了令人兴奋的功能,例如 Motion Brush、高级相机控制和导演模式。

它允许用户创建具有复杂场景变化、广泛电影选择和详细艺术指导的高度详细视频。

| 迅速的 | 输入图像 | 输出视频 |

| 高速、动态角度,摄像机锁定在沙地场景中漂浮在空中的塑料袋上。袋子是半透明的,随风上下漂浮,但在整个场景中仍然清晰可见且清晰对焦。 | 没有任何 |  |

| 戴着手套的手拉扯着由泡泡糖材料制成的脸 |  |  |

| 海葵在水中自然摇曳、流动,相机保持静止。 |  |  |

Act One

Act One是Runway Gen-3 Alpha版本中最令人兴奋的新增功能之一。它是一种角色动画工具,旨在制作人类主体最逼真、最真实的面部动作、说话方式和表情。

有了它,用户可以创建与真实角色一模一样的角色表演,并且可以采用多种风格,从人们交谈的逼真视频到迪士尼、皮克斯等主要动画工作室风格的可爱动画场景。

该工具之所以效果很好,是因为它是在大量面部动画数据和动作捕捉上进行训练的,为创造性表达开辟了许多新的机会。

| 驾驶性能 | 输出视频 |

| |

| |

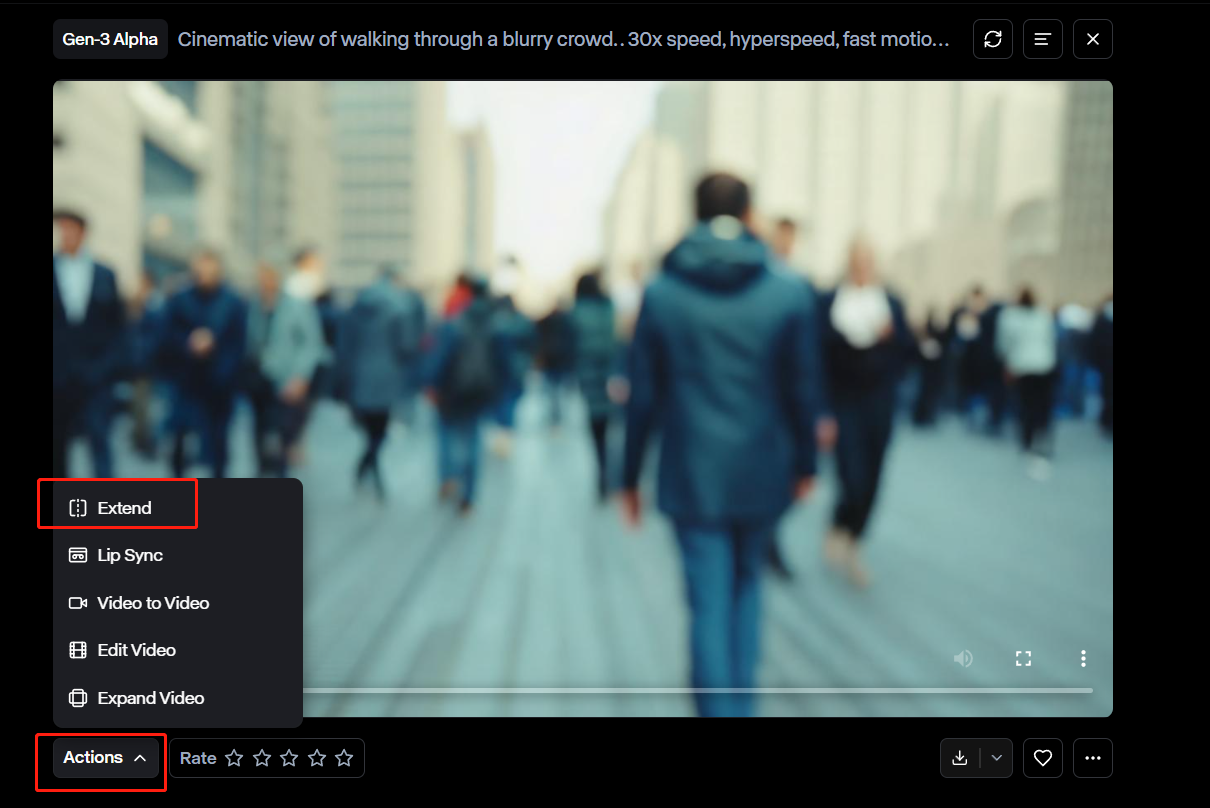

延长视频

使用Gen-3 Alpha,您可以让 AI 生成的视频比以前更长,以 5-10 秒为增量添加新内容部分。您还可以将单个视频延长三倍,使其比原来更长(最多可增加 40 秒)。

延长视频的过程也快速而简单——您只需在视频旁边的“操作”菜单中选择“延长”工具即可。

默认情况下,该工具会在原始视频的最后一帧之后添加新内容。您可以输入自己的文本提示,告诉 AI 模型要在扩展中包含哪些内容,描述场景、摄像机运动和其他因素。

Gen-3 Alpha还允许您根据需要选择 5 秒或 10 秒的附加时间。

| 原始视频 | 扩展视频 |

高保真输出

与之前的版本(如Gen-2)相比,Runway 的Gen-3 Alpha 将一致性和高保真输出提升到了新的水平。

它可以制作出最真实、最逼真的动作视频,包括走路、跑步、慢跑和跳跃等动作。每个动作都流畅逼真,没有奇怪的故障或其他人工智能模糊,让观众沉浸其中。

此外,新模型能够保持帧与帧之间的一致运动和视觉效果。这要归功于它对提示的出色理解和比上Gen-2更好的算法。

所有这些的交付速度也比以往更快 – Gen-3 Alpha比Gen-2快 2 倍。

高级时间控制

Runway 的Gen-3 Alpha模型经过训练,能够理解复杂、分层的提示,这些提示涉及多个场景和时间概念。正因为如此,它非常善于理解描述经历各种变化或过渡的场景或视觉效果的提示。

对于最终用户来说,这意味着Gen-3 Alpha能够高效地在每个视频的场景或片段之间生成流畅的过渡。它还让您能够更好地控制关键帧,因此您可以专门设置视频中特定事件发生或元素出现的精确时刻。

有了如此多的控制权,用户可以制作他们想要的精确的视频,而不必妥协。

栩栩如生的人物

Runway 的Gen-3 Alpha经过训练,可以让人类对象看起来尽可能逼真。换句话说,这些 AI 视频中的人类很难与真人区分开来。

无论是说话、表情,还是跑步、跳跃等各种动作,这些视频中的人物都十分逼真。这为用户在讲述故事和制作人性化内容方面提供了许多可能性。

口型同步音频

“唇形同步”功能可让您将音轨或语音与角色和主题的逼真唇部动作同步。

您可以为 AI 角色输入自己的脚本,直接在Runway中录制自己的声音,或上传音频文件。然后,Lip Sync 会将其与角色的嘴部动作同步,因此看起来就像他们在传递音频一样。

当您使用 Lip Sync 时,还可以配置和选择各种语音选项。

视频到视频生成

只需上传(或生成)一段视频,将其用作 AI 模型的基线或参考点。然后,它会让您以各种方式转换或更改该视频,例如将逼真的视频转换为动画视频,反之亦然。

| 输入视频 | 文字提示 | 输出视频 |

| 3D 半色调 CMYK 风格。半色调印刷点。漫画书。青色、黄色、洋红紫色和黑色圆点层次鲜明。 |  |

使用Runway Gen-3 Alpha的最佳提示

要充分利用Runway Gen-3 Alpha ,您需要使用最佳类型的提示。Runway 本身鼓励用户坚持“[镜头移动]:[建立场景]。[其他细节]。”公式。

例如,你可以输入这样的提示:“缓慢的水平摇摄,一位年轻女子走过沙漠,然后开始下雨。”

提示越详细,得到的结果就越具体、越有针对性。所以,如果你对视频的外观有一定的想法,最好详细一点。

我们可以将其应用到前面的例子,得到如下结果:

“镜头从左到右缓慢地扫过一片金色的沙漠。一位 20 多岁的女子缓缓走过这片场景。她穿着一件花裙子。她抬头望去,雨水开始从上方的灰色云层中落下。”

这里有一些额外的技巧,可以使你的提示达到最佳效果:

- 提供尽可能多的细节,但不要太过分。Gen Gen-3 Alpha最适合使用不太简单或复杂的“最佳点”提示。

- 了解有关摄像机运动和镜头类型的术语,以便您可以为工具提供有关取景和摄像机角度的精确指令。

- 在创建类似或后续场景时,在提示中使用相同的风格,以便它们保持一定程度的一致性。

- 尝试使用 Runway 自己的自定义预设提示,并保存您最喜欢的提示以供将来重复使用。

Runway Gen-2VS Gen-3 AlphaVS Gen-3 Alpha Turbo

| 特征 | Gen-2 | Gen-3 Alpha | Gen-3 Alpha Turbo |

| 视频时长 | 4秒 | 5/10秒 | |

| 视频分辨率 | 1408 × 768px (高级关闭) 2816 × 1536px (高档开启) | 1280x768像素 | 1280x768像素 768x1280像素 |

| 文字转视频 | |||

| 图像转视频 | |||

| 视频到视频 | |||

| 运动画笔 | |||

| 相机控制 | |||

| 自定义样式 | |||

| 口型同步 | |||

| 第一幕 | |||

| 展开视频 | |||

Reddit对Gen-3 Alpha的评论

那么,一般用户对 Runway 的Gen-3 Alpha有什么看法?嗯,目前,对该工具的看法有些混乱。

一些用户声称他们暂时会继续使用Gen-2 ,因为 Gen-3 还处于开发的“Alpha”阶段,在发挥其潜力之前还需要一些改进。

评论

来自u/West_Persimmon_6210的讨论

在runwayml

其他人抱怨使用Gen-3 Alpha的成本太高,但仍有人称赞它所引入的技术和关键功能。

评论

来自u/Puzzled-Emphasis1116的讨论

在runwayml

YouTube上的视频评论

有关Runway Gen-3 Alpha的更多文章

深入研究有关Runway Gen-3 Alpha的更多文章,以增强您对该模型的理解!

常见问题解答

Runway第三代 alpha 是什么?

Gen-3 Alpha是Runway AI视频生成模型的最新版本。与之前的Gen-2版本相比,它引入了一系列改进和新功能,例如 Lip Sync 功能。

Gen-3 Alpha和Gen-3 Alpha Turbo之间有什么区别?

Gen-3 Alpha和Gen-3 Alpha Turbo在效率和成本方面存在一些差异。也就是说,在创建内容方面, Gen-3 Alpha Turbo比普通的Gen-3 Alpha快得多。Turbo 的成本也更低,因为它需要更少的积分来生成视频,但标准 Alpha 可能会给你更可靠的结果。

Gen-3 Alpha与Gen-2文本/图像到视频有何不同?

与Gen-2相比, Gen-3 Alpha带来了各种改进和新功能。它提供更高质量的视频,在运动和物理方面更加一致、更加逼真。

如何尝试 gen-3 alpha?

您可以通过注册Runway或使用其他提供Runway Gen-3 Alpha模型的工具(如Pollo AI)免费试用Gen-3 Alpha 。您无需花费任何金钱即可试用此工具。

如何使用 Gen3 alpha?

Gen-3 Alpha 的工作原理与市面上的许多其他 AI 视频生成器非常相似。您可以选择上传图像作为创建 AI 视频的基准,也可以输入提示并配置各种设置来控制输出。

Runway Gen-3 免费吗?

并非完全免费,但您可以通过注册RunwayML的基本/免费计划免费使用它。但是,这只会为您提供有限的平台访问权限。如果您想要完全访问权限,则需要注册付费计划。

Gen 3 Alpha 有何用途?

Gen-3 Alpha是一种 AI 视频生成模型,可用于制作逼真的高质量 AI 视频。它有很多可能的应用,例如创建娱乐内容、广告、演示、教程等。

Runway Gen 3 需要多少学分?

目前,使用Gen-3 Alpha制作 AI 视频每秒需要花费 10 个积分。例如,制作一个 10 秒的视频将花费 100 个积分。使用Gen-3 Alpha的 Turbo 版本可以更便宜地获得视频,每秒仅需花费 5 个积分。

Gen-3 Alpha的最大长度是多少?

目前, Gen-3 Alpha可以制作最长 10 秒的剪辑。但是,您最多可以使用延长功能三次,将剪辑的总时长增加 30 秒,使剪辑最长可达 40 秒。

Gen 3 Alpha 视频的分辨率是多少?

使用Gen-3 Alpha (和Gen-3 Alpha Turbo)生成的视频的分辨率目前设置为 720p。但Runway团队表示,未来将发布更多选项。

Runway Gen-3 的价格是多少?

Runway使用积分系统,使用Gen-3 Alpha制作的每一秒视频都需要 10 个积分。您可以注册各种订阅计划,这些计划会为您提供不同数量的积分,包括免费计划(每月为您提供 125 个积分)和专业计划(每月为您提供 2250 个积分)。